Обучение с подкреплением во многом напоминает процесс обучения ребенка — регулярное повторение оттачивает технику. Однако, для того чтобы преимуществами этого метода мог воспользоваться робот, ему требуется вернуть в исходное состояние среду, в которой проходит обучение, а это трудоемкая задача, на выполнение которой у людей может уходить по несколько часов.

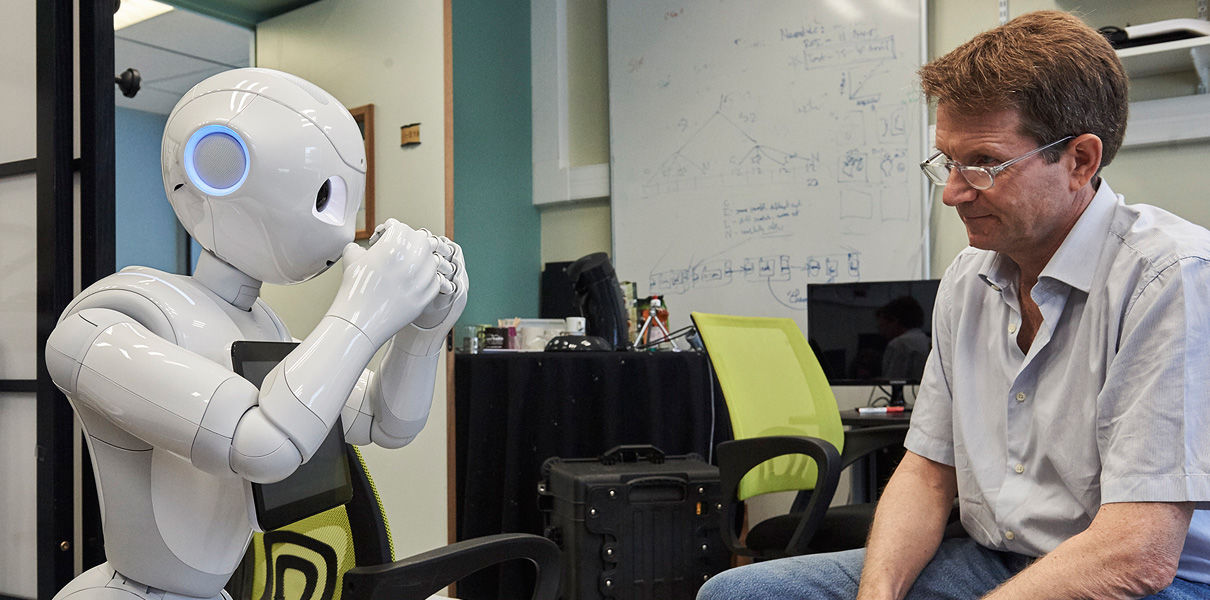

По словам авторов исследования, озаглавленного «Leave no Trace» («Не оставляя следов») и опубликованного в онлайн-архиве Корнеллского университета, они пытались развить у машин «интуицию», чтобы они могли классифицировать все, что подлежит восстановлению, как безопасные действия. Путем проб и ошибок робот открывает все больше и больше действий, которые можно обратить, отделяя их от необратимых, а значит — непригодных для обучения.

«Наши убеждения и чувства — плод бессознательных систем мозга»

Идеи

Обучение с подкреплением часто выполняется в реальных условиях испытательного полигона, например, когда беспилотный автомобиль движется по горному серпантину, и такие условия не прощают серьезных ошибок. Поэтому многие исследователи предпочитают виртуальные симуляции, но даже им рано или поздно приходится проводить реальные испытания, а с помощью нового алгоритма этот процесс станет быстрее и безопаснее, пишет MIT Technology Review.

Эта работа перекликается с другим исследованием, вышедшем в прошлом месяце и принадлежащем специалистам Facebook AI Research. В нем у одной машины есть два различных режима, Элис и Боб, один из которых пытается вернуть в исходное состояние то, что сделал другой. Такая система позволяет ИИ планировать заранее свои действия, уберегая себя (и нас) от разрушительных последствий.

25 главных изобретений 2017 года

Мнения

Когда обучение с подкреплением не дает желаемых результатов, в ход идет любознательность. Такую модель разработали для ИИ специалисты Университета Беркли, научив его действовать не ради вознаграждения, а для удоволетворения любопытства.