В заявлении ученых и правозащитников говорится, что оружие, контролируемое только искусственным интеллектом, может убивать невинных людей, поскольку самостоятельно будет выбирать себе цели. При этом право людей на жизнь слишком серьезно, чтобы давать возможность автономным устройствам лишать его.

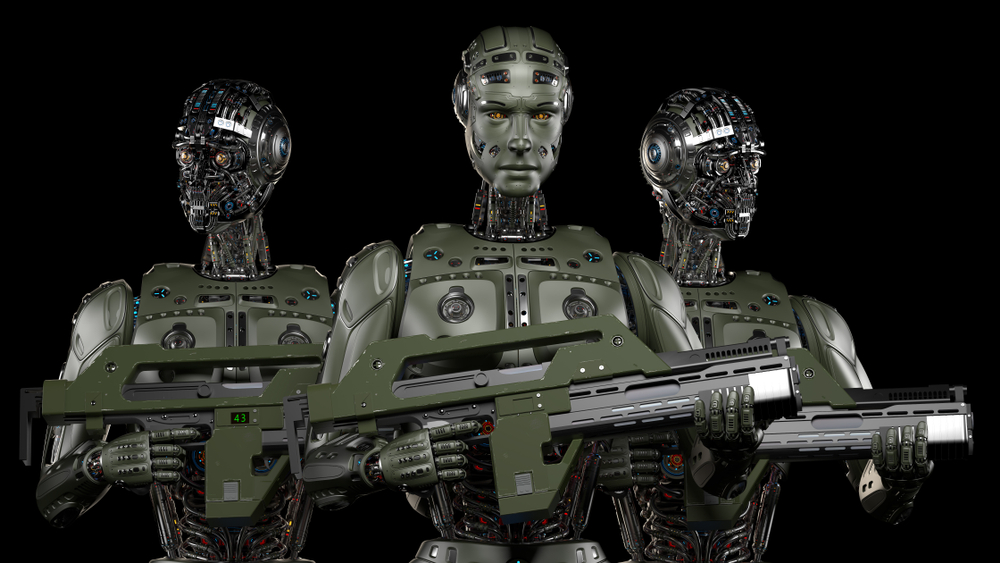

Мы, конечно, не говорим о гуляющих роботах-терминаторах, которые собираются захватить мир. Нас беспокоит намного более реальная вещь — системы обычного вооружения с элементами автономности. Дроны, военные самолеты, роботы-часовые, которые могут самостоятельно открывать огонь при малейшем движении. Все они — предшественники автономного оружия.

Директор Human Rights Watch Мэри Уэрхэм

В применении оружия автономными устройствами также до конца не ясно, кто виноват в случае, если робот решает убить невиновного человека, отмечает технический директор разработчика военных технологий Clearpath Robotics Райан Гариепи. Фактически алгоритм, по которому работает устройство, пишут программисты, однако задачи перед ним ставят военные, расположенные часто в тысячах километров от места проведения боя.

Недавно группа стран, в том числе Россия и США, выступили против прямого запрета на использование искусственного интеллекта в военных разработках. Например, Пентагон намерен вложить в разработку искусственного интеллекта более $2 млрд в ближайшие годы.

Ранее Google отказался от участия в конкурсе Пентагона на разработку облачных вычислений и искусственного интеллекта в области военных технологий на сумму около $10 млрд из-за протестов сотрудников компании.