По прогнозам, в течение следующих пяти лет самыми популярными приложениями с ИИ должны стать чатботы и виртуальные помощники. Будущее еще не наступило, но боты уже начинают портить человечеству жизнь. The Guardian подготовила обзор того, как боты мешают людям жить уже сегодня.

Боты разоряют людей

Несмотря на развитие финтеха и в частности ботов, которые совершают финансовые сделки, выполняют роль финансовых консультантов и могут накопить самым удачливым кучу денег, алгоритмы часто совершают ошибки. В итоге истории успеха уравновешивают истории провалов. Самым крупным из последних стало крушение британского фунта из-за действий финансовых роботов. В начале октября фунт рухнул на 6% после цепной реакции, когда боты один за другим начали продавать валюту.

Они лишают возможности посетить любимые концерты

Например, те, кто хотел бы посетить выступление рэпера Drake в Лондоне в начале следующего года уже вряд ли смогут это сделать. Виной всему боты, которые моментально скупили все билеты, как только они стали доступны на онлайн сервисах. Теперь вместо $50 их перепродают за $800.

Боты испортили Twitter

Боты — это худшее, что случалось социальными сетями. Они заполонили ее мусором. Стоит написать очередной пост, пишет жалуется корреспондент The Guardian, как тут же появляется некий @WiniPhone700802268 с рекламой очередного порносайта. Но боты в социальной сети используются не только для спама: в прошлом году армия ботов была использована, чтобы подавить протест против текущего президента Мексики. Алгоритмы искусственно выводили в топ нужные правительству хештеги. Что-то подобное боты проворачивают и в русском сегменте Twitter, плодя кучу одинаковых комментариев под разного рода оппозиционными постами. Похожая ситуация происходит в Instagram, который боты завалили дешевой рекламой самых бесполезных товаров и услуг.

Экономика будущего: аренда станет нормой, а владение — роскошью

Технологии

Убили романтику

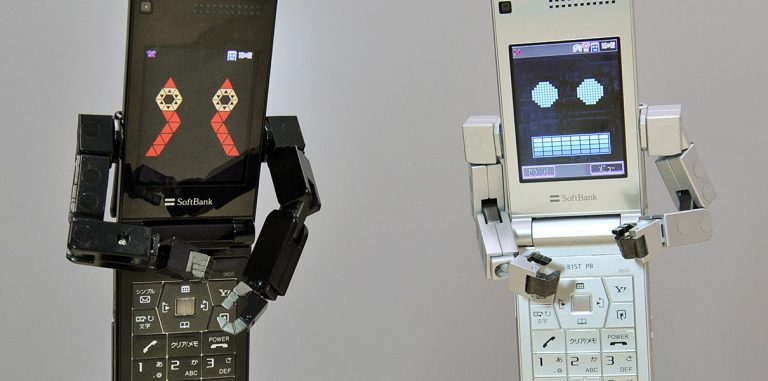

Все чаще появляется информация о том, что люди обращаются к ИИ типа Siri или Alexa с довольно интимными вопросами и просьбами. Обзоры на Alexa на тематических форумах начинаются с заголовков «распутная искусительница». Пользователи описывают, как «Alexa своим сексуальным голосом ответила» и прочее. Все это делает отношения между людьми и ботами даже более интимными чем в свое время между людьми и персонажами видеоигр. И возникают опасения, что дальше романтика переместится из отношения двух людей в отношения человека и ИИ, как в фильме «Она» Спайка Джонса. Остается ждать, что в скором времени кто-то начнет зарабатывать на теме сложных романтических взаимоотношений ботов и людей.

Они унижают

В прошлом году одним из самых популярных приложений в AppStore был бот Lark, задачей которого было помочь сбросить вес, нормализовать диету и помочь с упражнениями. На практике же он не только оказался бесполезным, но еще всячески унижал пользователей. В боте была предусмотрена возможность собирать данные о питании: например, когда ему говорили «я съела бекон», он едко замечал, что это уже третий раз за неделю и лучше бы вместо этого было пройтись, рассказывает девушка которая буквально возненавидела бота. Также вспоминается нашумевшая история с ботом от Microsoft, который быстро превратился в расиста, сексиста и хама.

Беспилотный грузовик Otto совершил первый коммерческий рейс

Кейсы

Боты убивают журналистику

Два года назад Los Angeles Times запустила Quakebot — он пишет новости о произошедших землетрясениях чуть ли не до того момента, как они произошли. Программа Wordsmith может одновременно выпускать тысячи материалов: писать некрологи, освещать футбольные матчи и политические дебаты. Associated Press использует ботов для отслеживания и публикации квартальных отчетов компаний — раньше их было 400, теперь 4000 и без бота это нереально. На The Telegraph работает алгоритм, который ведет субботний футбольный блог. Пока он не публикует ничего кроме фактов и лишних восклицательных знаков, но ИИ постоянно усложняется, поэтому журналистам следовало бы насторожиться, боты наступают.