Что если террористы спрячут бомбу в робота-уборщика и тайно пронесут его в здание правительства? Что если кибермошенники научат чатбота с точностью имитировать манеру речи человека? Группа экспертов в области искусственного интеллекта спрогнозировала главные угрозы, которые новые технологии несут человечеству. Авторы исследования предупредили - катастрофические сценарии могут реализоваться намного быстрее, чем кажется.

В новом исследовании «Применение ИИ со злым умыслом» специалисты по искусственному интеллекту описали основные риски, связанные с развитием машинного обучения, а также способы их предотвращения. Над отчетом работало более 20 футурологов, экспертов по ИИ и правозащитников. Среди них представители Института будущего человечества, Центра изучения экзистенциальных рисков, Фонда электронных рубежей и лаборатории OpenAI, которую спонсирует один из главных сторонников регулирования ИИ Илон Маск.

Физики из МТИ открыли новую форму света

Кейсы

Исследователи изучили возможные сценарии применения искусственного интеллекта в преступных целях в ближайшие пять лет. Большинство угроз, описанных в исследовании, связано со слежкой, нарушением приватности и искажением реальности. Алгоритмы на основе машинного обучения станут более дешевыми и доступными, и злоумышленники смогут автоматизировать многие задачи, которые раньше приходилось выполнять вручную.

В первую очередь автоматизация упростит направленные фишинговые операции. Собрать о человеке данные будет проще, чем когда-либо прежде, а сами атаки станут более завуалированными и изощренными. В прошлом останутся однообразные запросы от «друзей» с просьбой перевести деньги и фальшивые письма от банков, которые легко отличить от настоящих. Чатботы научатся имитировать манеру речи друга или родственника, а большие данные помогут втереться в доверие от имени банка или сервиса госуслуг. В исследовании эксперты также описывают применение ИИ для генерации фальшивого аудио- и видеоконтента.

О многих проблемах, описанных в отчете, недавно рассказывал специалист по соцсетям Авив Овадья. В интервью BuzzFeed он также описал чатботов-имитаторов и практику точечного фишинга. По мнению Овадьи, генерация убедительных фальшивок вызовет у людей апатию по отношению к реальности. Они перестанут проверять почту и прекратят обращать внимание на новости.

Авторы отчета допускают, что преступники используют существующие сегодня программы для своих целей. Например, алгоритм AlphaGo от DeepMind теоретически способен не только придумывать ходы в игре го, но и генерировать новые попытки взлома системы. Мощные хакерские атаки могут охватить тысячи компьютеров, а избавиться от вредоносного ПО можно будет только с помощью выкупа.

Другая технологическая угроза — это применение ИИ для слежки. Исследователи описывают зловещий сценарий в духе фильма «Особое мнение». Системы слежки в интернете и в офлайне наблюдают за человеком и контролируют все его действия и публикации в сети. Любой, кто решит протестовать против режима или критиковать правительство, может быть задержан. Причиной для ареста станет прогноз алгоритма, который увидел в человеке потенциальную угрозу.

Ничто не помешает государствам с тоталитарным режимом воздействовать таким образом на меньшинства или на другие неугодные группы людей. Процесс уже можно наблюдать Синьцзян-Уйгурском автономном районе КНР, жители которого из-за своей национальной принадлежности и вероисповедания попали под пристальное внимание властей. Внимание выражается в слежке с использованием систем распознавания лиц и даже в сборе ДНК-анализов.

Графеновый фильтр в один шаг очистил воду из Сиднейской бухты

Идеи

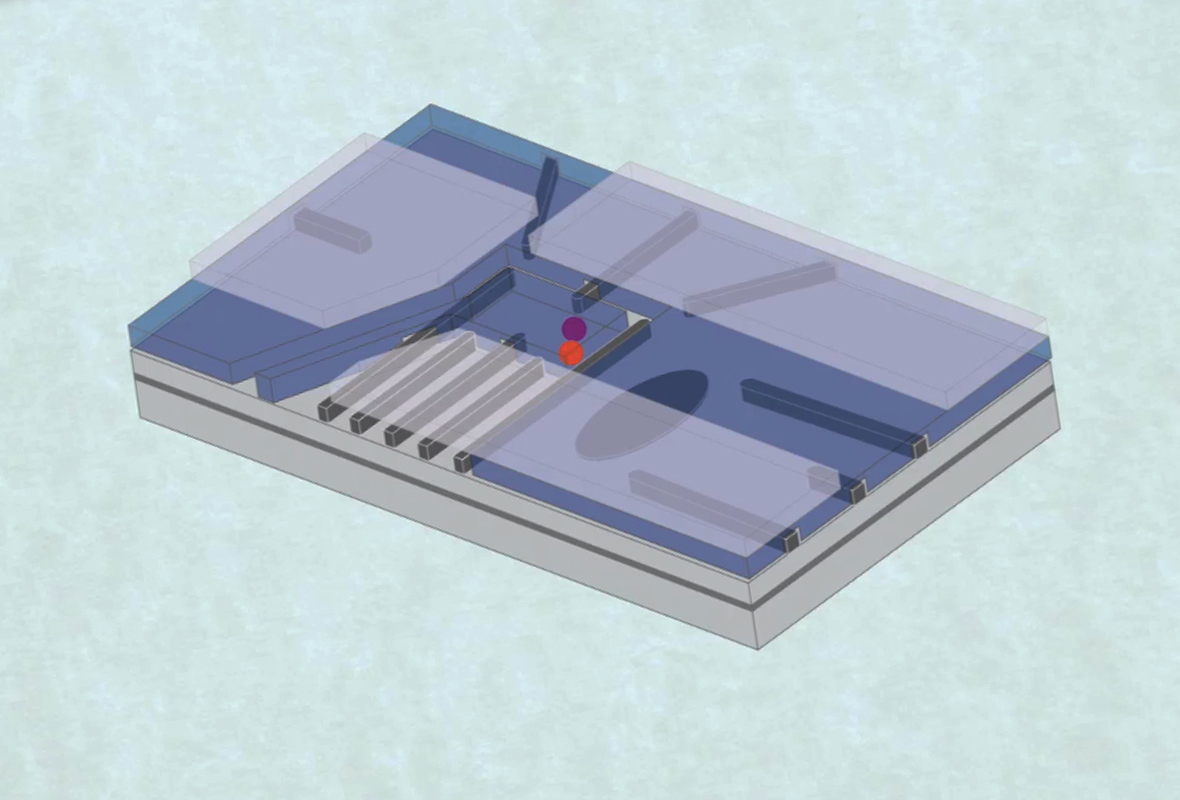

Один из описанных в отчете сценариев заслуживает серии в «Черном зеркале». Террористы незаметно внедряют в число правительственных роботов-уборщиков машину, оборудованную бомбой. Робот оснащен системой распознавания лиц, которая помогает ему узнать премьер-министра. При встрече с главой государства устройство детонирует.

Отдельный пункт исследования посвящен рекомендациям, но, как отмечает MIT Technology Review, большинство из них абстрактны. Пока эксперты советуют обсуждать проблему, исследовать риски и уделять больше внимания этике при подготовке специалистов по ИИ.

Однако проблема технологии в том, что она уже получает широкое распространение и становится все более дешевой и повсеместной. Более того, злоумышленникам достаточно один раз потратиться на разработку или покупку ПО — и в дальнейшем его можно будет использовать тысячи раз без каких-либо затрат. Масштабируемость — одна из главных проблем ИИ, пишут футурологи.

Intel создала квантовый компьютер в два кубита на кремниевом чипе

Технологии

Но отчаиваться эксперты не советуют — надежда удержать ИИ в рамках пока есть. «У нас не было задачи нарисовать мрачную картину — можно придумать много вариантов защиты, и нам еще многому стоит поучиться. Наше исследование не описывает безнадежность ситуации. Оно призывает к действию», — рассказал один из авторов исследования Майлз Брангейд.