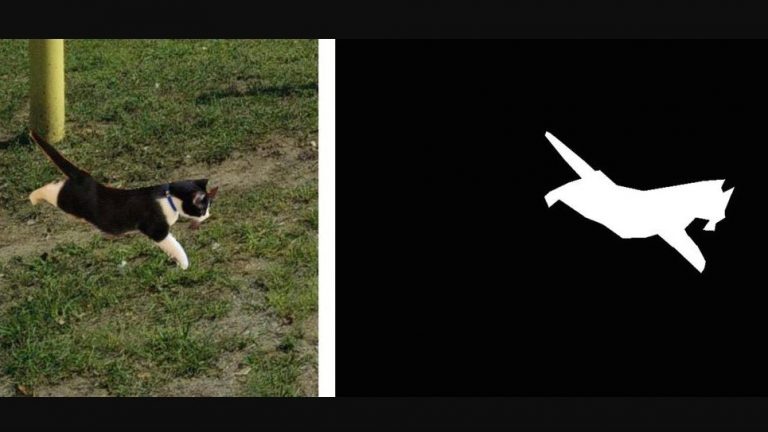

Команда ученых из Калифорнийского университета обучила нейронную сеть на большой базе отредактированных и неотредактированных фотографий, заранее пометив каждую из них. Система обращала внимание на пиксели вдоль границ объектов, которые часто выдают манипуляции.

Сеть концентрировалась на пикселях вдоль границ объектов — на поддельных снимках они более гладкие, чем на оригинальных кадрах. Эти различия не всегда может обнаружить человек, но компьютерное зрение делает это практически безошибочно.

Затем маркированный набор загрузили в глубокую нейронную сеть, которая представляет собой набор алгоритмов, смоделированных по образцу человеческого мозга и предназначенных для распознавания закономерностей в исходных данных. Используя картинки, эта сеть научилась определять основные границы цифровых изображений. Когда впоследствии ей показали фотографии, не вошедшие в набор данных, она смогла определить, какие из них фальшивые.

Пока система работает только с фотографиями, но в будущем сможет анализировать и видеокадры. При этом точность технологии никогда не будет 100-процентной. Скорее всего, она будет использоваться для того, чтобы отмечать подозрительные фотографии, которые потом будут анализировать люди.

«Если вы хотите проверить достоверность всего, что есть в интернете, особенно с появлением deepfake-видео, то вы не справитесь с этим. Автоматизированная система же, вероятно, справится с этим более надежно. Так что это должна быть совместная работа человека и машины», — отметили исследователи.